在当今数据驱动的时代,GPU服务器已经成为许多行业不可或缺的计算利器。无论是火爆的人工智能训练,还是复杂的科学计算,甚至是日常的图形渲染,都离不开GPU服务器的强大算力支持。那么,面对市场上琳琅满目的配置选项,我们应该如何选择最适合自己需求的GPU服务器呢?今天就来聊聊这个话题。

GPU服务器的核心作用

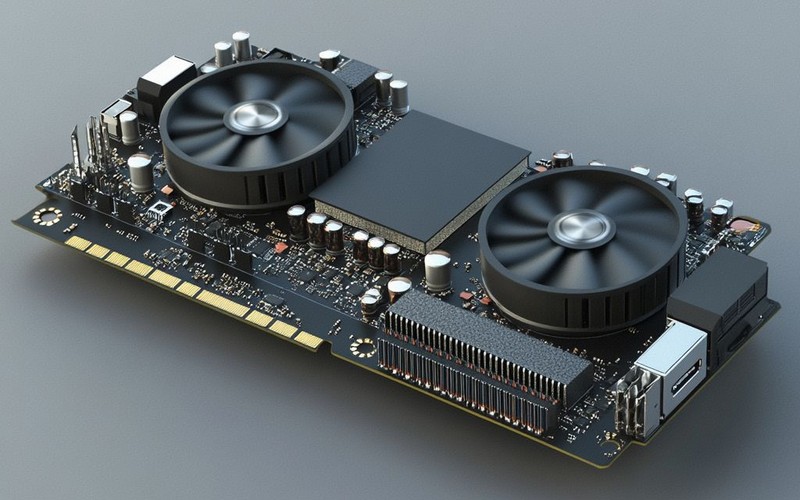

GPU服务器本质上是一种专门配备了图形处理器的服务器,它的最大特点就是能够进行大规模的并行计算。与传统的CPU服务器相比,GPU服务器在处理特定任务时能够提供数十倍甚至数百倍的性能提升。

具体来说,GPU服务器主要应用在以下几个领域:

- 人工智能与机器学习:深度学习模型的训练需要大量的矩阵运算,这正是GPU的强项

- 科学计算:包括天气模拟、分子动力学等复杂计算任务

- 图形渲染与视频处理:在影视制作、游戏开发等行业应用广泛

- 大数据分析:能够快速处理海量数据集

GPU选择:服务器的心脏部件

选择GPU是整个配置过程中最关键的一步,它直接决定了服务器的整体计算能力。目前市场上的GPU主要分为两大阵营:NVIDIA和AMD。

对于专业应用场景,NVIDIA的Tesla系列和AMD的Radeon Instinct系列是最常见的选择。这些专业级GPU不仅在计算性能上表现出色,还配备了高度优化的驱动程序,能够保证长时间稳定运行。

在选择GPU时,需要重点关注以下几个参数:

- 内存容量:决定了能够处理的数据集大小

- 浮点计算能力:通常用TFLOPS来衡量

- 内存带宽:影响数据传输速度

- 最大显示分辨率:对图形输出有要求的场景需要特别注意

对于深度学习等需要大量并行处理的任务,建议选择内存更大、计算能力更强的GPU,比如NVIDIA的A100系列。而对于图形渲染等任务,则可能需要更侧重图形输出性能的GPU型号。

CPU配置:GPU的得力助手

虽然GPU承担了主要的计算任务,但CPU的作用同样不容忽视。高性能的CPU能够有效处理GPU计算之前的准备工作,以及那些不适合GPU加速的任务。

在选择CPU时,需要考虑其与GPU的协同工作能力。特别是用于深度学习任务的GPU服务器,最好选择支持大量PCIe通道的CPU,这样才能保证多个GPU之间的数据传输效率。

CPU的核心数量、线程数、主频和缓存大小都会直接影响整体性能。还需要确保CPU与所选主板的兼容性,避免出现硬件不匹配的情况。

内存配置:数据处理的关键

内存配置是GPU服务器另一个需要重点考虑的方面。足够大的内存容量可以支撑更大的数据集载入内存,这对于数据分析、机器学习和科学计算等内存密集型任务至关重要。

目前主流的GPU服务器通常配置几十GB到几百GB不等的内存。为了兼顾性能和稳定性,建议选择DDR4 ECC内存,这种内存不仅速度快,还能自动检测和纠正内存错误,大大提高系统的可靠性。

内存速率也是需要考虑的因素,过慢的内存可能会成为整个系统处理速度的瓶颈。

存储系统:保证数据流畅性

存储系统必须足够快速,才能保证GPU计算时的高速数据流供应。在选择存储方案时,需要根据具体的工作负载来决定。

对于需要频繁读写大量数据的应用场景,建议配置高速的SSD硬盘,甚至是NVMe SSD,以确保数据能够快速地在存储设备和GPU内存之间传输。

实际应用场景配置建议

不同的应用场景对GPU服务器的配置要求也有所不同。下面针对几个典型场景给出具体的配置建议:

深度学习与AI训练:这是对GPU要求最高的场景之一。建议选择NVIDIA A100或同等级别的高性能GPU,内存至少64GB,存储系统配置高速SSD。如果预算允许,可以考虑配置多块GPU并通过NVLink技术连接,这样能够显著提升总体性能。

图形渲染与视频处理:这类应用更注重GPU的图形输出能力。NVIDIA的Quadro系列和AMD的Radeon Pro系列都是不错的选择。内存配置建议在128GB以上,CPU选择多核心的型号。

大数据分析:NVIDIA的V100系列GPU非常适合大数据分析任务,它能够在较短时间内完成复杂的数据处理工作。

扩展性与未来规划

在选择GPU服务器配置时,不仅要考虑当前的需求,还要为未来的业务增长留出足够的扩展空间。

这意味着在选择主板和机箱时,要确保有足够的扩展槽和空间,以便在需要时能够增加更多的GPU来提升计算能力。

配置GPU服务器确实是个技术活,但只要把握住核心要点,根据实际需求做出合理选择,就能找到最适合自己的配置方案。记住,最贵的未必是最好的,最适合的才是最好的。

内容均以整理官方公开资料,价格可能随活动调整,请以购买页面显示为准,如涉侵权,请联系客服处理。

本文由星速云发布。发布者:星速云。禁止采集与转载行为,违者必究。出处:https://www.67wa.com/140791.html